近日,第49届国际 ACM SIGIR(ACM SIGIR Conference on Research and Development in Information Retrieval,简称 SIGIR 2026)公布论文录用结果。官全龙、方良达团队在信息检索与人工智能领域取得重要进展,论文成果“Mitigating Evidence Suppression:Bi-level Active Evidence Injection for Educational Video Understanding”被 SIGIR 2026 Full Papers Track 录用。SIGIR 2026年录用率为18.4%。SIGIR是信息检索与人工智能领域公认的国际顶级学术会议之一,自1978年由ACM SIGIR主办,是中国计算机学会(CCF)推荐的 A 类国际学术会议。

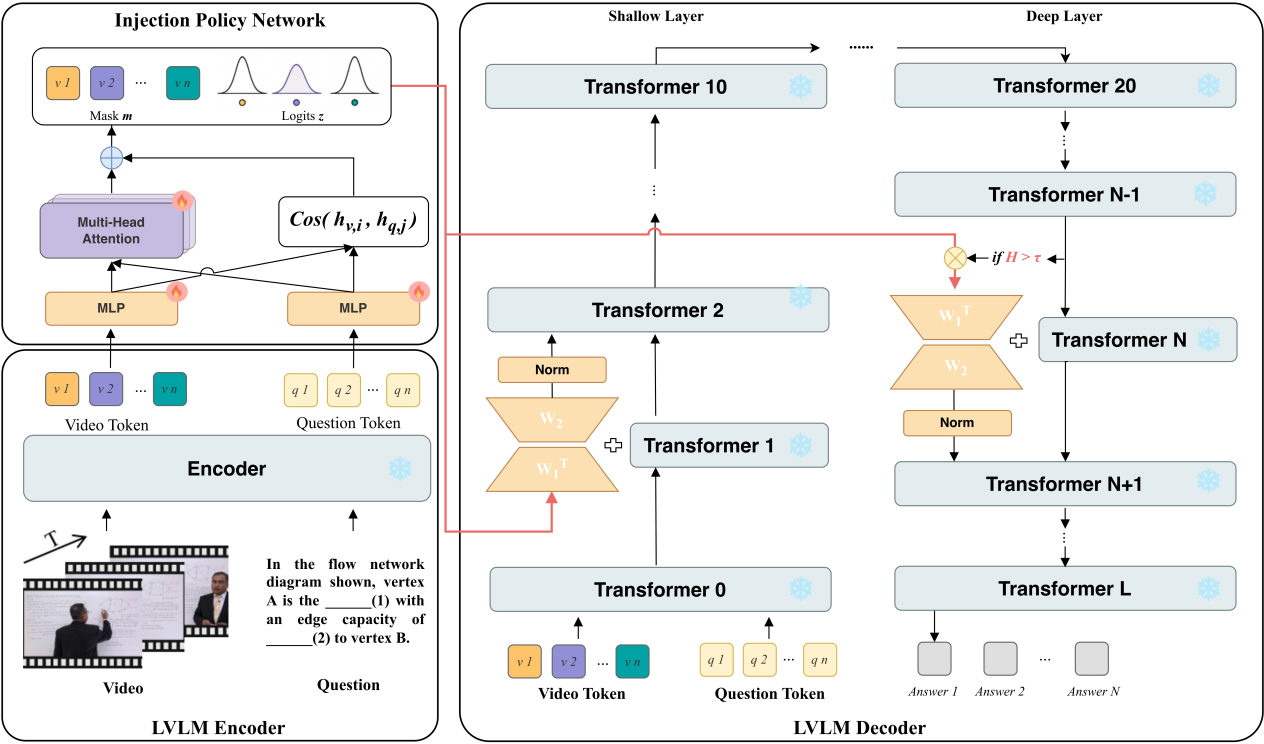

大型视觉语言模型(LVLM)在知识密集型教育视频问答任务中具有广阔应用前景,但即使相关视觉证据已经存在,模型在实际回答过程中仍常常不能充分利用这些关键信息。研究团队通过区域级分析发现,与干扰信息相比,任务关键的视觉 token(如图表等)在编码器输出中往往呈现出更低的表征能量,并在后续解码过程中被较少利用,表现出明显的“证据抑制”现象。这种现象会削弱模型对教育视频中核心内容的理解能力,从而影响回答准确率。为解决这一问题,团队提出双层主动证据注入方法(Bi-level Active Evidence Injection,BAEI)。该方法无需更新大型视觉语言模型主干参数,而是在解码阶段引入轻量级注入策略网络(Injection Policy Network,IPN),并通过 GRPO 优化,实现对候选证据 token 的动态选择和结构化残差注入。该框架在两个层面发挥作用:在浅层,通过干预提升证据相关视觉信号对后续解码过程的有效贡献;在深层,则根据预测熵自适应地进行校正,从而更稳定地增强模型对关键视觉证据的利用能力。教育领域基准数据集上的实验结果表明,该方法能够带来稳定的性能增益,验证了解码阶段面向证据信号进行主动干预的有效性。

论文作者是刘成、王一评、官全龙(通讯作者)、贺超波、朱星谕、方良达。该研究工作得到了国家自然科学基金项目(62377028,62276114,62477016)等项目的支持。

责编:常凯丽